Das kennen wir alle. Man sieht ein umwerfendes KI-Video auf X oder Soras Showcase – filmreife Beleuchtung, flüssige Bewegungen und professionelles Storytelling. Man ist inspiriert, öffnet seinen Lieblingsgenerator und gibt etwas ein wie: „Eine Cyberpunk-Stadt im Regen.“

Das Ergebnis? Ein verschwommenes, verwaschenes Durcheinander, das eher an einen Bildschirmschoner aus den 90ern als an einen Film erinnert.

Hier die ungeschminkte Wahrheit: Nicht die KI ist der Flaschenhals, sondern Ihre Eingabeaufforderung. Im Jahr 2026 reicht einfaches Keyword-Stuffing nicht mehr aus. Wenn Sie Ergebnisse auf Hollywood-Niveau erzielen wollen, müssen Sie die „Regisseurlogik“ hinter dem Workflow für die Eingabeaufforderung verstehen. Ob Sie nun Aufforderung aus dem Video extrahieren Ob Sie von den Großen lernen oder Ihren eigenen Stil von Grund auf neu entwickeln möchten – dieser Leitfaden ist Ihre Blaupause.

Was zeichnet eine gute KI-Video-Aufforderung aus?

In der heutigen Zeit geht es bei der Video-basierten Gesprächsführung nicht mehr nur um das Klicken eines Knopfes. Es erfordert eine zweifache Kompetenz:

-

Der VorwärtsflussDie Vision in Ihrem Kopf wird in strukturierten Text umgewandelt, den ein KI-Modell interpretieren kann.

-

Der umgekehrte Fluss (Auszug aus der Videoanweisung): Ein bestehendes KI-Meisterwerk nehmen und seine Text-DNA rückwärts entwickeln.

Mein NehmenWenn du Anfänger bist, beginne mit Reverse Engineering. Versuche nicht, das Rad neu zu erfinden. Nutze ein Video als Anstoß für den Generator, um zu sehen, wie Profis Kamerabewegungen und Beleuchtung beschreiben. Das ist der schnellste Weg, die „Sprache“ von KI-Modellen zu lernen.

Warum KI-Videoergebnisse scheitern

Bevor wir zu den Formeln kommen, sprechen wir über die Technik. Warum leiden KI-Videos unter „Verzerrungen“ oder „Halluzinationen“? Es dreht sich alles um zeitliche Konsistenz.

KI-Modelle generieren Videos, indem sie anhand des vorherigen Frames vorhersagen, wie der nächste Frame aussehen soll. Sind die Vorgaben für KI-Videos zu vage, hat die KI zu viel kreativen Spielraum. Sie beginnt zu raten, und dann bekommen Figuren zusätzliche Gliedmaßen oder Gesichter lösen sich auf.

Profi-Tipp: Je genauer Ihre Vorgaben sind, desto weniger muss die KI „raten“. Details sind Ihr Schutz gegen den Uncanny-Valley-Effekt.

Wie man Anweisungen für die KI-Videogenerierung schreibt

Ich habe Tausende von Eingabeaufforderungen in Veo, Runway und Kling getestet. Eine Struktur übertrifft dabei alle anderen:

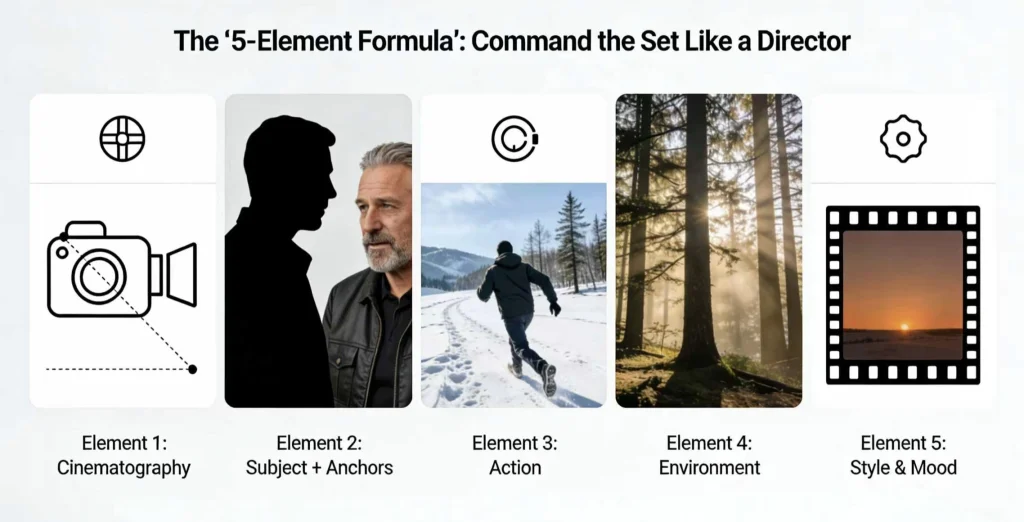

[Kameraführung] + [Thema + Ankerpunkte] + [Handlung] + [Umgebung] + [Stil & Stimmung].

Lassen Sie uns im Detail erläutern, warum jedes einzelne Element ein unverzichtbarer Bestandteil Ihres Arbeitsablaufs ist:

Kinematographie

Meiner Meinung nach ist dies der am meisten vernachlässigte Aspekt der Kamerasteuerung. Wenn man der KI nicht mitteilt, wo sich die Kamera befindet, wählt sie standardmäßig eine langweilige statische Aufnahme.

Statt einer Standard-Nahaufnahme versuchen Sie es doch mal mit einem Dolly-Zoom für mehr Spannung oder einer kraftvollen Untersicht, um Ihr Motiv in Szene zu setzen. Ich liebe es, Verwacklungen der Handkamera in meine Videos einzubauen. Das verleiht ihnen eine gewisse „menschliche Unvollkommenheit“ und lässt sie authentischer wirken, als wären sie von einem Menschen und nicht von einer Maschine aufgenommen worden. So lässt sich der künstliche „KI-Look“ ganz einfach vermeiden.

Betreff

Charakterdrift ist kein Fehler. Sie tritt auf, wenn das Modell keinen festen Halt hat.

Die Formulierung „ein Mann“ oder gar „ein Mann mittleren Alters“ lässt zu viel Interpretationsspielraum. Ich lege daher immer ein paar Begriffe fest. Ankerdetails:

Ein Mann in den Fünfzigern, mit grau meliertem Bartschatten und einer abgetragenen braunen Lederfliegerjacke

Darüber hinaus füge ich gerne noch eins hinzu unvollkommen Details – eine kleine Narbe, ein schiefer Ohrring, eine lose Haarsträhne. Diese vermeintlichen Makel sind wichtig. Sie geben dem Model einen visuellen Anknüpfungspunkt, und sobald dieser erkannt ist, verbessert sich die Konsistenz über mehrere Clips hinweg deutlich.

Action

KI-Videomodelle lieben Bewegung, aber ungenaue Bewegung lässt sie versagen.

„Laufen“ ist mehrdeutig. „Sprinten“ ist es nicht.

„Sprechen“ ist ausdruckslos. „Flüstern mit einem leichten Schmunzeln“ verleiht dem Gesicht etwas Ausdruck.

Was überraschend gut funktioniert, ist die Beschreibung des Gewichts. Anstatt „gehen“ zu sagen, versuchen Sie es mit … durch tiefen Schnee stapfenDieses eine Wort gibt dem Modell vor, wie sich der Körper neigen soll, wie langsam die Schritte sind und wie stark die Umgebung wirkt. Physikalische Prozesse verbessern sich, wenn die Bewegung einen Widerstand erfährt.

Arbeitsumfeld

Die Umgebung ist nicht Dekoration. Es ist das Beleuchtungssystem.

Bis 2026 verstehen Models, wie sich Licht verhält. Sie wissen, wie Neonlicht auf Leder reflektiert, wie Leuchtstoffröhren den Hautton fahl wirken lassen und wie das Licht der untergehenden Sonne Gesichter umspielt. Aber nur, wenn man ihnen sagt, woher das Licht kommt.

Ich bin bei den Lichtquellen sehr wählerisch: das Licht der goldenen Stunde, das durch die Redwoodbäume gefiltert wird, oder das grelle Flackern von Leuchtstoffröhren in einem sterilen Flur. Damit Ich füge oft auch eine subtile „Wetterschicht“ hinzu – Nebel, aufgewirbelten Staub, hohe Luftfeuchtigkeit. Diese Details verleihen Tiefe und verhindern das flache, leinwandartige Gefühl, das ansonsten gute Aufnahmen ruinieren kann.

Stil & Stimmung

Dies ist der letzte Durchgang. Das digitale Filmmaterial.

Technische Referenzen spielen nach wie vor eine Rolle. Das Filmkorn von 35-mm-Film verleiht ihm mehr Struktur. Kodak Portra 400 verbessert fast immer die Hauttöne. Doch was letztendlich alles verbindet, ist die Art und Weise, wie es fühlt sich.

Wörter wie melancholisch, euphorischden angespannt Sie beeinflussen nicht nur die Farbkorrektur. Sie wirken sich auch auf das Tempo, kleinste Bewegungen und sogar die Verweildauer der Kamera aus. Die Stimmung ist es, die ein gutes Video zu einem unvergesslichen macht.

Die Wahl des richtigen KI-Videogenerators im Jahr 2026

Verschiedene Modelle interpretieren Eingabeaufforderungen unterschiedlich, daher können die Ergebnisse selbst bei Verwendung desselben Textes variieren. Das Verständnis dieser Unterschiede hilft Ihnen, vorhersehbarere und nutzbarere Ergebnisse zu erzielen.

Google Veo Es besticht durch seinen Realismus und ein ausgeprägtes Gespür für filmische Bildsprache. Zudem unterstützt es Audiohinweise, wodurch es sich besonders für dialoglastige Szenen und atmosphärisches Storytelling eignet.

LandebahnEs bietet durch seine Bearbeitungswerkzeuge und Bewegungssteuerung eine direktere Kontrolle. Daher wird es häufig in professionellen Arbeitsabläufen bevorzugt, insbesondere bei Bild-zu-Video-Projekten, bei denen Präzision entscheidend ist.

Kling KI ist vor allem für seinen stilisierten Grafikstil und Anime-inspirierte Inhalte bekannt. Es reagiert gut auf künstlerische und illustrative Vorgaben und ist im Allgemeinen toleranter beim Experimentieren mit kreativen Ideen.

Sora Es zeichnet sich durch die Darstellung komplexer Interaktionen und physikalischer Realität aus. Bei Szenen mit mehreren Personen und längerer zeitlicher Kohärenz erzielt es bessere Ergebnisse als die meisten anderen Modelle, profitiert aber dennoch von klaren, beschreibenden Anweisungen.

Wenn man weiß, mit welchem Modell man arbeitet, kann man Formulierungen, Detaillierungsgrad und Erwartungen entsprechend anpassen.

Wie man die Eingabeaufforderung aus einem Video extrahiert

Möchtest du den Stil eines Videos, das du auf Reddit gesehen hast, „kopieren“? Hier ist mein professioneller Workflow zum Extrahieren von Ansagen:

Schritt 1: Der KI-Multi-Modal-Hack

Raten Sie nicht einfach. Laden Sie das Video in ein multimodales Lernmanagementsystem wie Gemini oder ChatGPT hoch. Verwenden Sie diese spezifische Meta-Aufforderung:

„Verhalten Sie sich wie ein professioneller Kameramann. Analysieren Sie dieses Video Bild für Bild. Beschreiben Sie die Beleuchtung, das verwendete Objektiv (z. B. 35 mm, 85 mm), die Kamerabewegung, die Details des Motivs und die Farbgebung. Fassen Sie dies abschließend in einer strukturierten 5-Elemente-Anweisung für einen KI-Videogenerator zusammen.“

Schritt 2: Verfeinerung mit einem Video-zu-Prompt-Generator

Tools wie promptaivideos.com eignen sich hervorragend für einen schnellen Entwurf einer Schreibanregung, erfassen aber oft nicht die richtige Stimmung. Kombinieren Sie die technische Analyse der KI mit Ihren eigenen subjektiven Beobachtungen der Stimmung, um eine optimale Schreibanregung zu erhalten.

Die besten KI-Video-Prompts für verschiedene Stile

Filmdokumentation: Konzentriert sich auf „Realität“ss." Verwenden Sie körniges Filmmaterial, natürliches Licht und ungezwungene Bewegungen.

Die „One-Take“-Aufnahme (mit Zeitstempel)Eine sehr schwierige Fähigkeitl. Sie legen Bewegungen in bestimmten Sekunden fest: 0:00-0:05: Hineinzoomen, 0:05-0:10: Das Motiv dreht sich.

Anime/Künstlerisch: Stark auf Stil setzen Schlüsselwörter wie Studio-Ghibli-Ästhetik oder Makoto-Shinkai-Beleuchtung.

Die „Traumlandschaft“Hohe Nutzung Zeitlupe, ätherisches Leuchten, weicher Fokus.

AnkerhinweiseWird zum Geschichtenerzählen verwendet. Die Figur bleibt in 10 verschiedenen Szenen identisch.

Start-/Endbildsteuerung: Entscheidende for-Schleifen.

Negative AufforderungMein „geheimes sauce” Liste: kein Morphing, keine zusätzlichen Finger, kein Text, kein Wasserzeichen, kein Flackern.

Häufige Fehler beim Schreiben von Video-Prompts

Eines der häufigsten Probleme ist die Überfrachtung von Eingabeaufforderungen mit zu vielen Details. Modelle haben Grenzen, und wenn alles betont wird, kommt am Ende nichts mehr zum Tragen.

Ein weiteres häufiges Problem ist die schwache Definition des Themas. Ohne konkrete Ankerpunkte wirken die Figuren zwischen den Einstellungen ziellos, was die Immersion stört.

Viele Nutzer erwarten auch zu viel von einer einzigen Generation. Kurze, prägnante Clips, die zusammengeschnitten werden, sehen fast immer besser aus als eine einzige lange Generation.

Die Verwendung identischer Eingabeaufforderungen auf verschiedenen Plattformen führt schließlich häufig zu Frustration. Kleine Anpassungen basierend auf dem Nutzerverhalten können hier einen großen Unterschied machen.

Abschließende Tipps für bessere KI-Video-Prompts

Der Wandel bis 2026 ist deutlich: Technisches Können wird durch Geschmack ersetzt. Videobasierte Ansagen sind kein Betrug, sondern die neue Art, Filme zu drehen. Egal, ob Sie einen Videogenerator nutzen, um schneller zu lernen, oder stundenlang an der perfekten Ansage feilen – denken Sie daran: Die KI ist nur die Kamera. Sie sind der Regisseur.

Bereit loszulegen? Beschreiben Sie mir eine Szene, an deren Gestaltung Sie Schwierigkeiten haben, und ich schreibe Ihnen umgehend eine professionelle, fünfteilige englische Drehbuchanregung.

Häufig gestellte Fragen zu Video-Aufforderungen

Wie schreibt man eine gute Video-Prompt?

Eine gute Videoanweisung beschreibt klar, was in der Szene passiert, wie sich die Kamera verhält und welche Wirkung das Video erzielen soll. Konkrete Aktionen, Lichthinweise und Stilreferenzen führen in der Regel zu stimmigeren und realistischeren Ergebnissen.

Was sind gängige Anregungen für KI-Videos?

Gängige KI-Video-Vorgaben umfassen eine Person, die in einer definierten Umgebung eine eindeutige Handlung ausführt, kombiniert mit Kamerarichtung, Lichtverhältnissen und einem visuellen Stil. Diese Struktur hilft dem Modell, stabile Bewegungen und stimmige Szenen zu generieren.

Wie wandelt man ein Video in eine Eingabeaufforderung um?

Die Umwandlung eines Videos in eine Schreibvorlage beinhaltet das Aufschlüsseln des Videos in Schlüsselelemente wie Charaktere, Handlungen, Kamerabewegung, Beleuchtung und Stimmung und die anschließende Übersetzung dieser Beobachtungen in Text.

Was ist ein Video-zu-Prompt-Generator?

Ein Video-zu-Text-Generator ist ein Tool, das ein Video analysiert und anhand seiner visuellen und Bewegungsmerkmale einen Textaufruf erstellt. Diese Aufrufe eignen sich am besten als Ausgangspunkt und müssen oft manuell angepasst werden.