Pourquoi les images GPT 2 semblent plus utiles aux créateurs

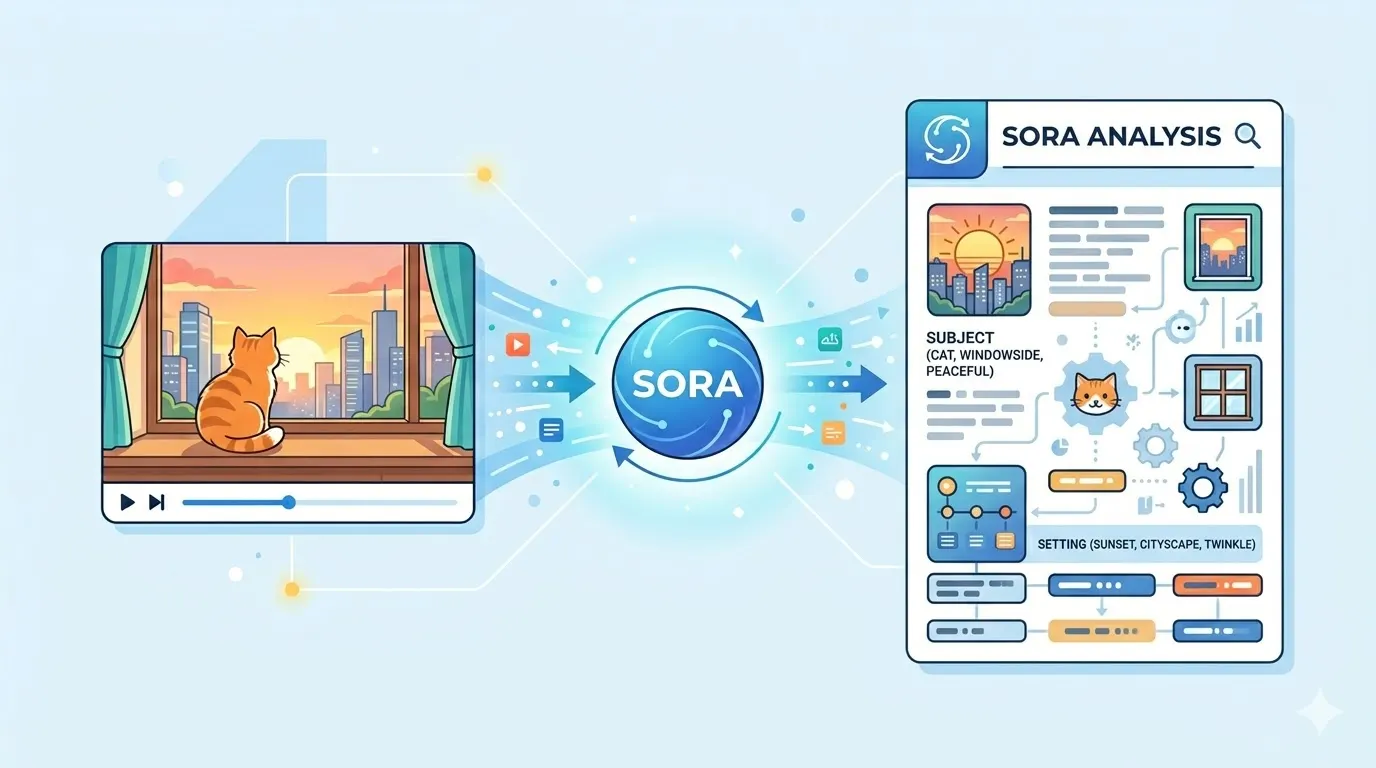

GPT Image 2 attire l'attention car ses images ressemblent moins à des expériences et plus à des ressources que les créateurs peuvent réellement utiliser. Il ne s'agit pas seulement de détails plus nets ou de styles plus jolis. La véritable amélioration est d'ordre pratique : texte plus clair, mises en page plus épurées, caractères plus uniformes, visuels de produits soignés et premières images plus percutantes pour les vidéos IA. Pour les créateurs, cela compte. Une bonne image IA ne doit pas seulement être impressionnante pendant cinq secondes. Cela devrait être suffisamment utile pour une couverture de blog, une miniature, une publication sur les réseaux sociaux, un concept publicitaire ou un récit visuel. Alors, qu'est-ce qui change concrètement dans GPT Image 2 ? Voyons voir où cela s'améliore — et où cela ressemble encore à de l'IA. Pourquoi GPT Image 2 se distingue des anciens modèles d'images IA : Les anciens modèles d'images IA pouvaient paraître impressionnants au premier abord, mais leurs défauts apparaissaient rapidement : texte tronqué, mises en page désordonnées, caractères incohérents et visuels soignés qui semblaient encore artificiels. GPT Image 2 se distingue par une meilleure gestion des aspects pratiques de la génération d'images. Les affiches sont plus lisibles, les produits sont plus clairs, les personnages restent plus reconnaissables et les visuels semblent plus pertinents. C’est pourquoi les créateurs y prêtent attention : cela ne permet pas seulement de créer des images plus jolies, mais aussi plus utilisables. Les effets d'image les plus remarqués : GPT Image 2 se distingue par le fait que ses améliorations apparaissent là où les créateurs les utilisent réellement. Les résultats ne sont pas seulement plus esthétiques ; ils sont aussi plus faciles à transformer en vignettes, couvertures, visuels de produits, éléments graphiques pour les articles et premières images de vidéos. Le texte dans les images est beaucoup plus lisible. L'amélioration du texte est l'une des plus évidentes. Les anciens modèles d'images d'IA pouvaient créer un fond d'affiche de qualité, puis le gâcher avec des lettres cassées, de faux mots ou des symboles illisibles. Cela rendait l'image difficile à utiliser pour les vignettes, les publicités, les étiquettes de produits, les menus et les publications sur les réseaux sociaux. GPT Image 2 gère mieux les textes courts. Les titres sont plus nets, les étiquettes plus lisibles et le texte simple des affiches paraît plus intentionnel. C’est important car les visuels des créateurs reposent souvent sur quelques mots clairs : une miniature YouTube a besoin d’un élément accrocheur, une couverture TikTok d’une phrase percutante et une maquette de produit d’une étiquette qui ne paraisse pas cassée. Néanmoins, ce n'est pas parfait. Les textes longs, les prix, les dates, les noms de marques, les mentions légales et les textes non anglais nécessitent encore une vérification manuelle. Les affiches et les couvertures semblent plus travaillées : GPT Image 2 donne également aux affiches, aux couvertures et aux visuels promotionnels une apparence plus aboutie. Au lieu de placer un texte aléatoire sur un joli fond, cela crée souvent une relation plus claire entre le sujet, le titre, l'espacement, l'éclairage et le fond. Cela le rend utile pour les couvertures de blogs, les miniatures YouTube, les couvertures TikTok, les publicités de produits, les images de campagnes et les graphismes pour les réseaux sociaux. Le mot clé est direction. GPT Image 2 peut vous aider à explorer rapidement une idée visuelle, mais il ne remplace pas les fichiers de conception réels. Une affiche générée reste une image plate, et non un fichier Figma ou Photoshop composé de calques. Des personnages plus cohérents La cohérence des personnages est un autre aspect important pour les créateurs. Si vous créez une histoire, une bande dessinée, une mascotte ou une vidéo d'IA, une seule bonne image ne suffit pas. Le personnage doit rester reconnaissable d'une scène à l'autre. GPT Image 2 semble mieux gérer l'harmonie entre le visage, la tenue, les couleurs et le style général. Ceci est utile pour les références de personnages, les storyboards, les variations d'expression et les premières images de vidéos générées par IA. Une première image plus nette offre aux outils de conversion d'images en vidéo un meilleur point de départ. Des images réalistes plus soignées : GPT Image 2 permet de créer des images réalistes nettes et soignées. Les portraits, les maquettes de produits, les scènes de vie, les photos de studio et les visuels commerciaux ont souvent un aspect plus raffiné et se rapprochent davantage de supports de marque utilisables. Mais poli ne signifie pas toujours naturel. Certaines images paraissent encore trop lisses, trop contrôlées ou légèrement artificielles. Pour les créateurs, l'objectif n'est pas seulement de donner à une image un aspect coûteux. Cela doit aussi paraître crédible. Les images structurées sont plus utiles. L'un des changements les plus utiles concerne la façon dont GPT Image 2 gère les visuels structurés. Ce sont des images explicatives, comme des bandes dessinées, des diagrammes, des présentations de produits, des graphiques étape par étape, des cartes ou des images avant-après. C'est important car de nombreux visuels de créateurs doivent communiquer rapidement. GPT Image 2 semble mieux organiser les panneaux, les étiquettes, les titres et les sections, mais les faits, les chiffres et les instructions doivent encore être revus avant publication. En quoi GPT Image 2 ressemble encore à une IA : GPT Image 2 est plus utile que les anciens modèles d’images IA, mais il a encore des limites. Les problèmes surviennent généralement lorsque l'image nécessite un texte précis, un réalisme naturel ou un aspect moins soigné, propre au quotidien. Les textes longs peuvent aussi poser problème. Les titres et les étiquettes courts sont bien meilleurs, mais les textes longs restent risqués. Une affiche avec un seul titre percutant peut paraître nette, tandis qu'une infographie détaillée, une description de produit ou un paragraphe peuvent encore contenir de petites erreurs. Cela a son importance pour les publicités, les visuels de produits, les tutoriels et les graphiques pédagogiques. Si les mots sont importants, ils doivent toujours être vérifiés manuellement. Les textes non anglais nécessitent encore une vérification. Les textes non anglais se sont améliorés, mais ils ne sont pas encore totalement fiables. Le chinois, le japonais, le coréen, l'arabe et d'autres langues peuvent paraître visuellement convaincants, mais certains caractères ou mots peuvent tout de même être incorrects. Pour les créateurs multilingues, GPT Image 2 est utile pour des concepts rapides, mais la publication finale nécessite toujours une relecture par un locuteur natif. Les scènes de nature peuvent paraître trop artificielles. La nature est plus complexe qu'il n'y paraît. GPT Image 2 peut créer de magnifiques paysages, mais les arbres, les nuages, les montagnes, l'herbe, l'eau et la lumière du soleil peuvent paraître trop nets ou trop contrôlés. Parfois, chaque partie de l'image semble aussi détaillée, ce qui rend la scène moins naturelle. Le résultat peut être magnifique, mais pas toujours crédible. Certaines images sont trop parfaites. De nombreuses images GPT Image 2 paraissent nettes, soignées et haut de gamme. Cela fonctionne bien pour les concepts de produits ou les visuels commerciaux, mais cela peut paraître artificiel pour le contenu du quotidien. Les photos réelles présentent souvent de petites imperfections : un éclairage inégal, des arrière-plans désordonnés, une peau imparfaite ou un cadrage approximatif. Pour un résultat plus authentique, demandez un éclairage naturel, des imperfections réalistes, des textures moins lissées ou une photographie décontractée plutôt qu'un style publicitaire de luxe. Comment utiliser GPT Image 2 gratuitement ? Vous pouvez utiliser GPT Image 2 directement dans ChatGPT. Après la mise à jour, certains utilisateurs

Des résultats vidéo réalistes m'ont impressionné

La qualité m'a impressionné : les expressions sont restées fidèles tandis que le mouvement semblait naturel partout. Mon partenaire a adoré la surprise d'anniversaire que j'ai créée à l'aide des outils gratuits make hugging video ai qui donnent vie à nos photos d'une manière que nous n'aurions jamais imaginée. Cette technologie donne des résultats significatifs qui résonnent émotionnellement chez tous ceux qui les regardent.

Outil vidéo parfait pour la distance

Étant à l'étranger, ces clips comblent considérablement les écarts émotionnels pour ma famille qui attend à la maison pendant de longues périodes de séparation. Ma fille regarde son contenu tous les soirs, apportant réconfort et connexion malgré la distance physique qui nous sépare. Cet outil gratuit d'IA offre des connexions spéciales aux familles séparées du monde entier grâce à des animations d'étreinte motorisées qui semblent authentiques et véritablement sincères.

Fonctionnalités vidéo révolutionnaires

En tant que créateur, ces fonctionnalités surpassent systématiquement les publications régulières sur toutes les principales plateformes sur lesquelles mon contenu est publié et partagé avec mes abonnés. L'authenticité émotionnelle résonne à travers une création de qualité que le public apprécie profondément et avec laquelle il interagit plus fréquemment que le contenu standard. Je recommande cet outil pour créer un contenu convaincant qui se connecte de manière significative avec les abonnés et crée des liens communautaires plus solides au fil du temps.

Expérience vidéo commémorative significative

J'ai créé du contenu avec la photo de ma grand-mère, produisant des résultats touchants grâce à la technologie. Nous voir nous embrasser dans la forme a apporté un immense réconfort pendant le deuil. Ce générateur de contenu offre des capacités commémoratives spéciales grâce à une création optimisée honorant magnifiquement les précieux souvenirs.

Création vidéo incroyablement simple

J'ai téléchargé ma photo, reçue magnifique en une minute sans complications. L'interface est intuitive et offre d'excellents résultats à chaque fois. Ce générateur de contenu tient ses promesses sans complexité pour les utilisateurs de tous horizons techniques.

Possibilités de création vidéo infinies

Création de contenu avec des personnages produisant des projets uniques à des fins diverses. La polyvalence vidéo prend en charge remarquablement diverses applications. Chaque génération maintient la qualité quel que soit le matériau source. Cette technologie a ouvert des possibilités créatives que je n’aurais jamais imaginé explorer.

Des résultats vidéo réalistes m'ont impressionné

La qualité m'a impressionné : les expressions sont restées fidèles tandis que le mouvement semblait naturel partout. Mon partenaire a adoré la surprise d'anniversaire que j'ai créée à l'aide des outils gratuits make hugging video ai qui donnent vie à nos photos d'une manière que nous n'aurions jamais imaginée. Cette technologie donne des résultats significatifs qui résonnent émotionnellement chez tous ceux qui les regardent.

Outil vidéo parfait pour la distance

Étant à l'étranger, ces clips comblent considérablement les écarts émotionnels pour ma famille qui attend à la maison pendant de longues périodes de séparation. Ma fille regarde son contenu tous les soirs, apportant réconfort et connexion malgré la distance physique qui nous sépare. Cet outil gratuit d'IA offre des connexions spéciales aux familles séparées du monde entier grâce à des animations d'étreinte motorisées qui semblent authentiques et véritablement sincères.

Fonctionnalités vidéo révolutionnaires

En tant que créateur, ces fonctionnalités surpassent systématiquement les publications régulières sur toutes les principales plateformes sur lesquelles mon contenu est publié et partagé avec mes abonnés. L'authenticité émotionnelle résonne à travers une création de qualité que le public apprécie profondément et avec laquelle il interagit plus fréquemment que le contenu standard. Je recommande cet outil pour créer un contenu convaincant qui se connecte de manière significative avec les abonnés et crée des liens communautaires plus solides au fil du temps.

Expérience vidéo commémorative significative

J'ai créé du contenu avec la photo de ma grand-mère, produisant des résultats touchants grâce à la technologie. Nous voir nous embrasser dans la forme a apporté un immense réconfort pendant le deuil. Ce générateur de contenu offre des capacités commémoratives spéciales grâce à une création optimisée honorant magnifiquement les précieux souvenirs.

Création vidéo incroyablement simple

J'ai téléchargé ma photo, reçue magnifique en une minute sans complications. L'interface est intuitive et offre d'excellents résultats à chaque fois. Ce générateur de contenu tient ses promesses sans complexité pour les utilisateurs de tous horizons techniques.

Possibilités de création vidéo infinies

Création de contenu avec des personnages produisant des projets uniques à des fins diverses. La polyvalence vidéo prend en charge remarquablement diverses applications. Chaque génération maintient la qualité quel que soit le matériau source. Cette technologie a ouvert des possibilités créatives que je n’aurais jamais imaginé explorer.