Por que as imagens GPT Image 2 parecem mais úteis para criadores?

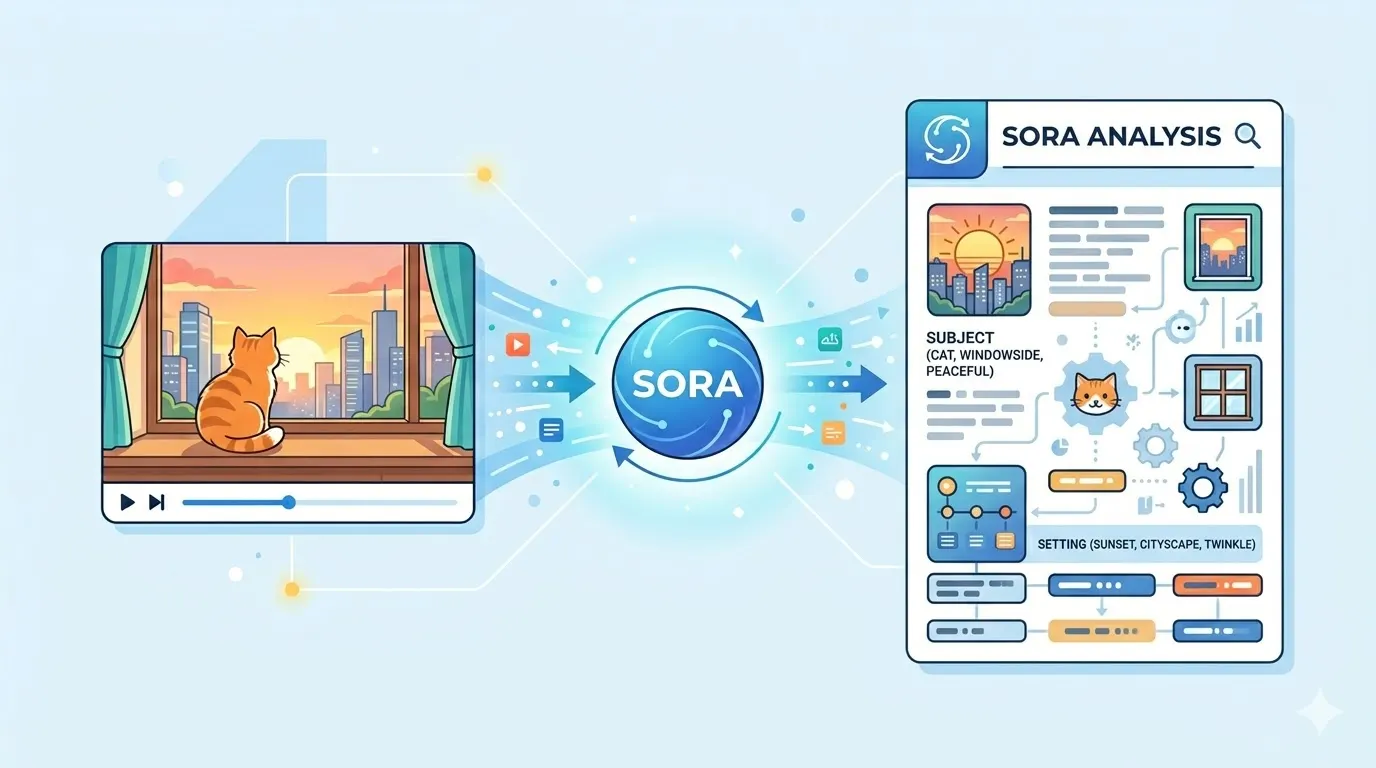

O GPT Image 2 está chamando a atenção porque suas imagens parecem menos experimentos e mais recursos que os criadores podem realmente usar. Não se trata apenas de detalhes mais nítidos ou estilos mais bonitos. A verdadeira melhoria é prática: texto mais claro, layouts mais limpos, caracteres mais consistentes, visuais de produto aprimorados e primeiros frames mais fortes para vídeos com IA. Para os criadores, isso importa. Uma boa imagem gerada por IA não deve impressionar apenas por cinco segundos. Deve ser útil o suficiente para uma capa de blog, miniatura, postagem em redes sociais, conceito de anúncio ou narrativa visual. Então, o que exatamente parece diferente na Imagem 2 do GPT? Vamos analisar onde há melhorias — e onde ainda parece IA. Por que o GPT Image 2 parece diferente dos modelos de IA de imagem mais antigos? Os modelos de IA de imagem mais antigos podiam parecer impressionantes à primeira vista, mas as falhas apareciam rapidamente: texto quebrado, layouts confusos, caracteres inconsistentes e visuais refinados que ainda pareciam artificiais. O GPT Image 2 parece diferente porque lida melhor com o lado prático da geração de imagens. Os cartazes estão mais legíveis, os produtos mais nítidos, os personagens mais reconhecíveis e os elementos visuais parecem mais objetivos. É por isso que os criadores estão prestando atenção — isso não apenas resulta em imagens mais bonitas, mas também mais úteis. Os efeitos de imagem que as pessoas mais notam: o GPT Image 2 se destaca porque suas melhorias aparecem nos locais que os criadores realmente utilizam. Os resultados não são apenas mais bonitos; são mais fáceis de transformar em miniaturas, capas, imagens de produtos, recursos para histórias e primeiros frames de vídeos. O texto nas imagens fica muito mais legível. Essa é uma das melhorias mais evidentes. Os modelos de IA mais antigos conseguiam criar um fundo de pôster impactante, mas depois o arruinavam com letras quebradas, palavras falsas ou símbolos ilegíveis. Isso dificultou o uso da imagem em miniaturas, anúncios, rótulos de produtos, menus e publicações em redes sociais. O GPT Image 2 lida melhor com textos curtos. Os títulos estão mais limpos, as legendas mais fáceis de ler e o texto simples do pôster parece mais intencional. Isso é importante porque os elementos visuais dos criadores muitas vezes dependem de apenas algumas palavras claras: uma miniatura do YouTube precisa de um gancho, a capa de um vídeo do TikTok precisa de uma frase impactante e a apresentação de um produto precisa de um rótulo que não pareça quebrado. Ainda assim, não é perfeito. Textos longos, preços, datas, marcas, pequenos avisos legais e conteúdos em outros idiomas ainda precisam de verificação manual. Pôsteres e capas parecem mais elaborados. A GPT Image 2 também faz com que pôsteres, capas e materiais visuais promocionais pareçam mais completos. Em vez de simplesmente colocar um texto aleatório sobre um fundo bonito, isso geralmente cria uma relação mais clara entre o assunto, o título, o espaçamento, a iluminação e o fundo. Isso o torna útil para capas de blogs, miniaturas do YouTube, capas do TikTok, anúncios de produtos, imagens de campanhas e gráficos para redes sociais. A palavra-chave é direção. O GPT Image 2 pode ajudar você a explorar rapidamente uma ideia visual, mas não substitui arquivos de design reais. Um pôster gerado automaticamente ainda é uma imagem plana, não um arquivo em camadas do Figma ou do Photoshop. Personagens mais consistentes. A consistência dos personagens é outro efeito que os criadores valorizam. Se você estiver criando uma história, uma história em quadrinhos, um mascote ou um vídeo com inteligência artificial, uma única boa imagem não é suficiente. A personagem precisa permanecer reconhecível em todas as cenas. A imagem GPT 2 parece ser melhor em manter a conexão entre o rosto, a roupa, as cores e o estilo geral. Isso é útil para referências de personagens, storyboards, variações de expressões e primeiros frames de vídeos com IA. Um primeiro quadro mais forte oferece às ferramentas de conversão de imagem em vídeo um ponto de partida melhor. Imagens realistas com aparência mais profissional: O GPT Image 2 pode criar imagens realistas nítidas e com acabamento impecável. Retratos, maquetes de produtos, cenas de estilo de vida, fotos de estúdio e imagens comerciais geralmente têm uma aparência mais refinada e se aproximam mais de materiais de marca utilizáveis. Mas refinado nem sempre significa natural. Algumas imagens ainda parecem muito suaves, muito controladas ou ligeiramente artificiais. Para os criadores, o objetivo não é apenas fazer com que uma imagem pareça cara. Também deve parecer verossímil. Imagens estruturadas são mais úteis. Uma das mudanças mais úteis é a forma como o GPT Image 2 lida com elementos visuais estruturados. São imagens que explicam algo, como histórias em quadrinhos, diagramas, explicações de produtos, gráficos passo a passo, mapas ou imagens de antes e depois. Isso é importante porque muitos recursos visuais de criadores precisam comunicar rapidamente. O GPT Image 2 parece organizar melhor os painéis, rótulos, títulos e seções, mas os fatos, números e instruções ainda precisam ser revisados antes da publicação. Onde o GPT Image 2 ainda parece IA: O GPT Image 2 é mais útil do que os modelos de IA de imagem mais antigos, mas ainda tem limitações. Os problemas geralmente surgem quando a imagem exige texto exato, realismo natural ou uma aparência cotidiana menos polida. Textos longos ainda podem dar errado. Títulos e rótulos curtos são muito melhores, mas textos longos ainda representam um risco. Um pôster com um título chamativo pode parecer limpo, enquanto um infográfico detalhado, uma descrição de produto ou um parágrafo ainda podem conter pequenos erros. Isso é importante para anúncios, imagens de produtos, tutoriais e gráficos educacionais. Se as palavras forem importantes, devem sempre ser verificadas manualmente. O texto em outros idiomas ainda precisa ser revisado. Embora tenha havido melhorias, ele ainda não é totalmente confiável. Embora o chinês, o japonês, o coreano, o árabe e outros idiomas possam parecer visualmente convincentes, alguns caracteres ou palavras ainda podem estar incorretos. Para criadores multilíngues, o GPT Image 2 é útil para conceitos rápidos, mas a publicação final ainda precisa de revisão no idioma nativo. Cenas da natureza podem parecer muito artificiais. A natureza é mais difícil do que parece. O GPT Image 2 consegue criar paisagens belíssimas, mas árvores, nuvens, montanhas, grama, água e luz solar podem parecer muito nítidos ou controlados demais. Às vezes, todas as partes da imagem parecem igualmente detalhadas, o que faz com que a cena pareça menos natural. O resultado pode ser belo, mas nem sempre convincente. Algumas imagens são perfeitas demais. Muitas imagens do GPT Image 2 parecem limpas, polidas e de alta qualidade. Isso funciona bem para conceitos de produtos ou visuais comerciais, mas pode parecer artificial para conteúdo do dia a dia. As fotos reais costumam ter pequenas imperfeições: iluminação irregular, fundos desarrumados, pele com imperfeições ou enquadramento casual. Se você deseja um resultado mais autêntico, peça iluminação natural, imperfeições realistas, texturas menos polidas ou fotografias casuais em vez de um visual de anúncio de luxo. Como usar o GPT Image 2 gratuitamente: Você pode usar o GPT Image 2 diretamente no ChatGPT. Após a atualização, alguns usuários

Melhor Gerador de Beijo Grátis

Este gerador me surpreendeu com sua qualidade incrível! Criei um clipe de aniversário e meu parceiro adorou o resultado. Parece tão natural que amigos acharam que era real.

Beijo de Língua com IA Funciona Muito Bem

O efeito de beijo de língua parece incrivelmente natural. É definitivamente o melhor gerador que já testei online.

Fácil e Sem Marcas d'Água

Adorei os resultados. Não há marcas d'água, o que é uma grande vantagem em comparação com outras ferramentas no mercado.

Vídeo Emocionante

Criei um clipe para nosso aniversário de três anos e ficou perfeito. A animação capturou o momento com detalhes muito realistas.

Parece Imagem Real

As animações parecem filmagens reais capturadas por um profissional. Qualquer pessoa pode usar, independentemente da experiência técnica.

Recurso de Beijar o Crush Incrível

Amo este recurso para expressar meus sentimentos! Os resultados são simples de alcançar, mas incrivelmente belos.

Melhor Gerador de Beijo Grátis

Este gerador me surpreendeu com sua qualidade incrível! Criei um clipe de aniversário e meu parceiro adorou o resultado. Parece tão natural que amigos acharam que era real.

Beijo de Língua com IA Funciona Muito Bem

O efeito de beijo de língua parece incrivelmente natural. É definitivamente o melhor gerador que já testei online.

Fácil e Sem Marcas d'Água

Adorei os resultados. Não há marcas d'água, o que é uma grande vantagem em comparação com outras ferramentas no mercado.

Vídeo Emocionante

Criei um clipe para nosso aniversário de três anos e ficou perfeito. A animação capturou o momento com detalhes muito realistas.

Parece Imagem Real

As animações parecem filmagens reais capturadas por um profissional. Qualquer pessoa pode usar, independentemente da experiência técnica.

Recurso de Beijar o Crush Incrível

Amo este recurso para expressar meus sentimentos! Os resultados são simples de alcançar, mas incrivelmente belos.