Proč se obrázky GPT Image 2 zdají být pro tvůrce užitečnější

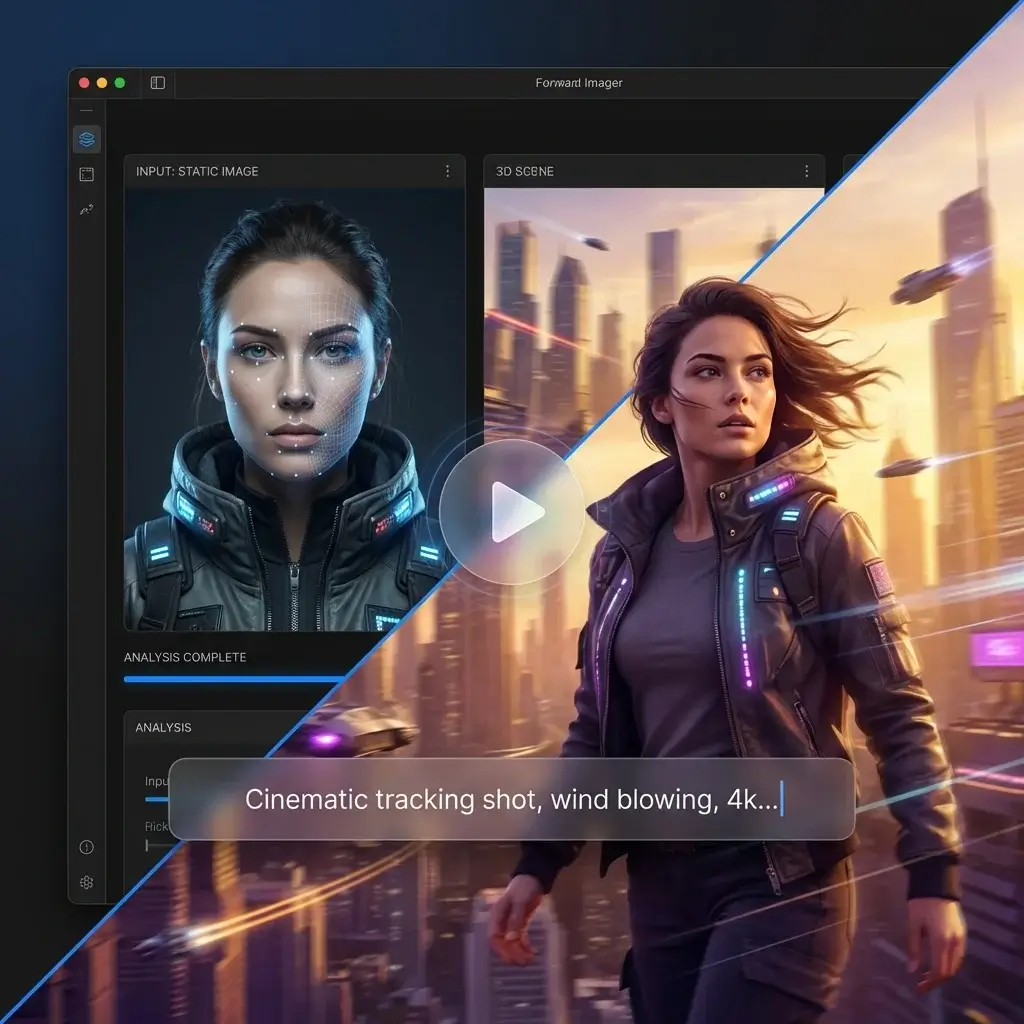

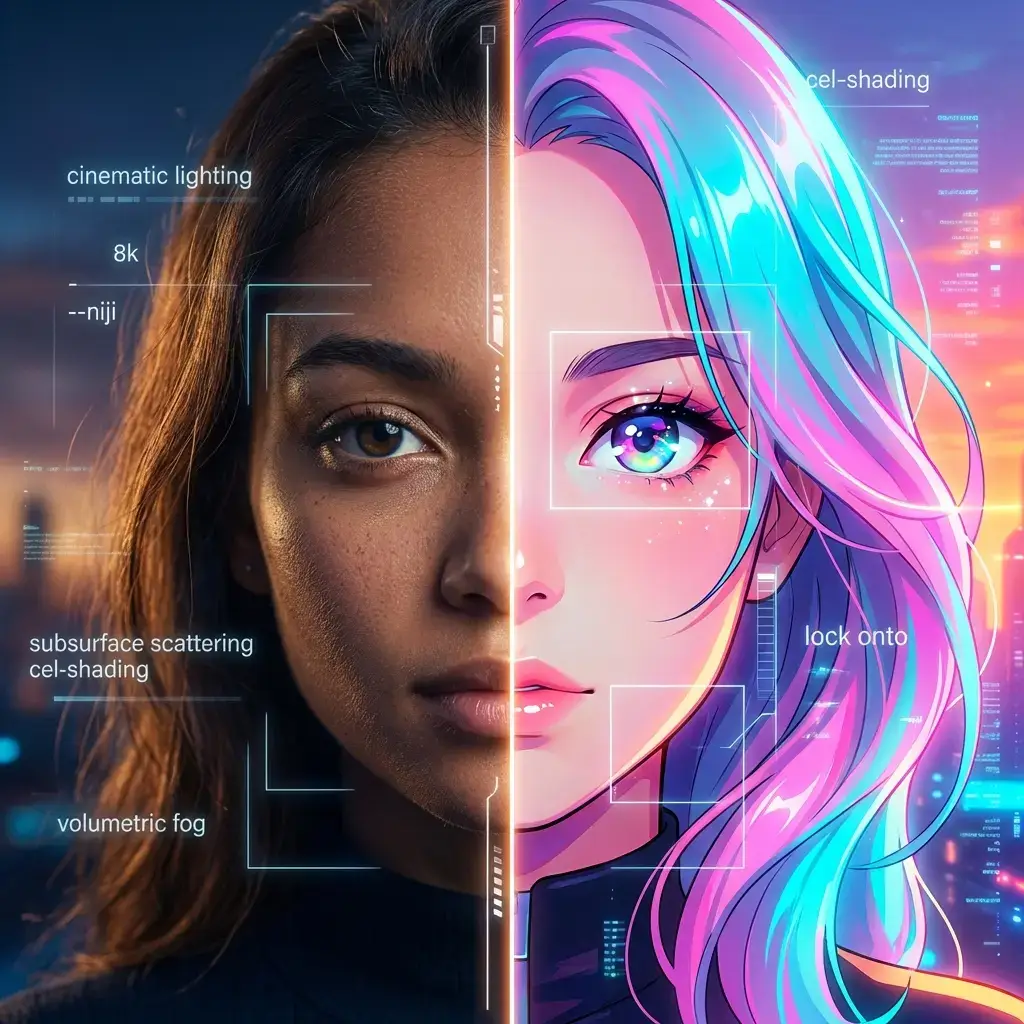

GPT Image 2 přitahuje pozornost, protože jeho obrázky působí méně jako experimenty a spíše jako zdroje, které mohou tvůrci skutečně použít. Nejde jen o ostřejší detaily nebo hezčí styly. Skutečné vylepšení je praktické: jasnější text, čistší rozvržení, konzistentnější znaky, propracovanější vizuální prvky produktů a výraznější první snímky pro videa s umělou inteligencí. Pro tvůrce je to důležité. Dobrý obrázek z umělé inteligence by neměl vypadat působivě jen pět sekund. Mělo by to být dostatečně užitečné pro titulní stranu blogu, miniaturu, příspěvek na sociálních sítích, reklamní koncept nebo vizuální příběh. Co se tedy ve skutečnosti v GPT Image 2 jeví jinak? Pojďme se podívat, kde se zlepšuje – a kde se stále chová jako umělá inteligence. Proč se obrázek GPT 2 liší od starších modelů obrázků s umělou inteligencí Starší modely obrázků s umělou inteligencí mohly na první pohled vypadat působivě, ale jejich nedostatky se rychle projevily: nefunkční text, chaotické rozvržení, nekonzistentní znaky a uhlazená grafika, která stále působila uměle. GPT Image 2 se zdá být odlišný, protože lépe zvládá praktickou stránku generování obrázků. Plakáty vypadají čitelněji, produkty jsou jasnější, postavy zůstávají rozpoznatelnější a vizuální prvky působí účelněji. Proto tvůrci věnují pozornost – nejenže to vytváří hezčí obrázky, ale i ty použitelnější. Obrazové efekty, kterých si lidé všímají Většina GPT Image 2 působí odlišně, protože jeho vylepšení se objevují na místech, která tvůrci skutečně používají. Výsledky nejsou jen hezčí; snáze se z nich dají vytvořit miniatury, obaly, vizuály produktů, prvky pro příběhy a první snímky videí. Text v obrázcích vypadá mnohem čitelněji. Text je jedním z nejpřehlednějších vylepšení. Starší obrazové modely s umělou inteligencí mohly vytvořit silné pozadí plakátu a poté ho zničit rozbitými písmeny, falešnými slovy nebo nečitelnými symboly. Kvůli tomu bylo obtížné obrázek použít pro miniatury, reklamy, štítky produktů, nabídky a příspěvky na sociálních sítích. GPT Image 2 lépe zvládá krátký text. Názvy vypadají čistěji, popisky se snáze čtou a jednoduchý text plakátu působí záměrněji. To je důležité, protože vizuální prvky pro tvůrce často závisí jen na několika jasných slovech: miniatura na YouTube potřebuje poutavé téma, obálka na TikToku tučné fráze a maketa produktu potřebuje popisek, který nevypadá poškozeně. Přesto to není dokonalé. Dlouhý text, ceny, data, názvy značek, drobná upozornění a texty v jiném jazyce než v angličtině je stále třeba ručně kontrolovat. Plakáty a obaly působí lépe navrženým dojmem. GPT Image 2 také dodává plakátům, obalům a propagačním vizuálům ucelenější vzhled. Místo umístění náhodného textu na pěkné pozadí se často vytváří jasnější vztah mezi předmětem, názvem, mezerami, osvětlením a pozadím. Díky tomu je užitečný pro obaly blogů, miniatury na YouTube, obaly na TikTok, produktové reklamy, obrázky kampaní a grafiku pro sociální sítě. Klíčovým slovem je směr. GPT Image 2 vám může rychle pomoci prozkoumat vizuální nápad, ale nenahrazuje skutečné návrhové soubory. Vygenerovaný plakát je stále plochý obrázek, nikoli vrstvený soubor Figma nebo Photoshop. Postavy zůstávají konzistentnější Konzistence postav je dalším efektem, na kterém tvůrci dbají. Pokud vytváříte příběh, komiks, maskota nebo video s umělou inteligencí, jeden dobrý obrázek nestačí. Postava musí zůstat rozpoznatelná napříč scénami. Obrázek GPT 2 se zdá být lepší v propojení obličeje, oblečení, barev a celkového stylu. To je užitečné pro reference postav, storyboardy, variace výrazů a první snímky videa s umělou inteligencí. Silnější první snímek poskytuje nástrojům pro převod obrazu na video lepší výchozí bod. Realistické obrázky vypadají uhlazeněji. GPT Image 2 dokáže vytvářet čisté a uhlazené realistické obrázky. Portréty, makety produktů, lifestylové scény, studiové snímky a komerční vizuály často vypadají propracovaněji a blíže použitelnému materiálu pro značky. Ale leštěné ne vždy znamená přírodní. Některé snímky stále vypadají příliš hladce, příliš kontrolovaně nebo mírně uměle. Pro tvůrce není cílem jen to, aby obrázek vypadal draze. Mělo by to také působit věrohodně. Strukturované obrázky jsou užitečnější Jednou z nejužitečnějších změn je způsob, jakým GPT Image 2 zpracovává strukturované vizuály. Jde o obrázky, které něco vysvětlují, například komiksy, diagramy, popisy produktů, podrobné grafiky, mapy nebo obrázky před a po. To je důležité, protože mnoho vizuálů pro tvůrce potřebuje rychle komunikovat. GPT Image 2 se zdá být lepší v organizaci panelů, štítků, nadpisů a sekcí, ale fakta, čísla a pokyny je stále třeba před publikováním zkontrolovat. Kde se GPT Image 2 stále jeví jako AI GPT Image 2 je užitečnější než starší modely obrázků s AI, ale stále má svá omezení. Problémy se obvykle objevují, když obrázek potřebuje přesný text, přirozený realismus nebo méně uhlazený každodenní vzhled. Dlouhý text se stále může pokazit. Krátké názvy a popisky jsou mnohem lepší, ale dlouhý text je stále riskantní. Plakát s jedním tučným nadpisem může vypadat čistě, zatímco podrobná infografika, popis produktu nebo odstavec může stále obsahovat drobné chyby. To je důležité pro reklamy, vizuální prvky produktů, návody a vzdělávací grafiku. Pokud jsou slova důležitá, měla by být vždy zkontrolována ručně. Neanglický text stále potřebuje kontrolu. Neanglický text se sice zlepšil, ale není zcela spolehlivý. Čínština, japonština, korejština, arabština a další jazyky mohou vypadat vizuálně přesvědčivě, ale některé znaky nebo slova mohou být stále chybné. Pro vícejazyčné tvůrce je GPT Image 2 užitečný pro rychlé návrhy, ale finální publikování stále vyžaduje kontrolu v rodném jazyce. Přírodní scenérie mohou vypadat příliš synteticky. Příroda je těžší, než vypadá. Obrázek GPT 2 dokáže vytvořit krásné krajiny, ale stromy, mraky, hory, tráva, voda a sluneční světlo se mohou zdát příliš ostré nebo příliš kontrolované. Někdy každá část obrazu vypadá stejně detailně, což scénu činí méně přirozenou. Výsledek může být krásný, ale ne vždy věrohodný. Některé obrázky jsou až příliš dokonalé. Mnoho obrázků GPT Image 2 vypadá čistě, uhlazeně a luxusně. To funguje dobře pro produktové koncepty nebo komerční vizuály, ale pro každodenní obsah to může působit falešně. Skutečné fotografie často mívají drobné nedokonalosti: nerovnoměrné osvětlení, neuspořádané pozadí, nedokonalou pleť nebo nedbalé záběry. Pokud chcete autentičtější výsledek, požádejte o přirozené osvětlení, realistické nedokonalosti, méně propracované textury nebo ležérní fotografii místo vzhledu luxusní reklamy. Jak používat obrázek GPT 2 zdarma Obrázek GPT 2 můžete použít přímo v ChatGPT. Po aktualizaci někteří uživatelé

Nejlepší AI Image to Video Generator

Sora 2 úplně změnila můj pracovní postup. Převod je neuvěřitelně rychlý a výsledky vypadají pokaždé profesionálně.

Open AI Quality Impressed Me

Technologie Sora 2 přináší úžasné výsledky. Moje agentura nyní používá tento generátor pro všechny klientské projekty.

Cena Sora 2 je rozumná

Zkontroloval jsem cenu sora 2 a okamžitě se zaregistroval. Hodnota, kterou získáte z generátoru, nemá na trhu obdoby.

Milujte funkci Sora 2 Prompts

Použití výzev sora 2 usnadňuje vytváření obsahu. Vytvářím anime klipy denně a Sora 2 přesně rozumí tomu, co chci.

Sora 2 funguje perfektně

Rozhraní Sora 2 je intuitivní. Generování obsahu z mých fotografií trvá jen pár minut. Vřele doporučuji každému tvůrci.

Žádné problémy s vodoznakem Sora AI

Prémiový plán zcela odstraní vodoznak sora AI. Moje komerční klipy vypadají čistě a profesionálně díky Sora 2.

Nejlepší AI Image to Video Generator

Sora 2 úplně změnila můj pracovní postup. Převod je neuvěřitelně rychlý a výsledky vypadají pokaždé profesionálně.

Open AI Quality Impressed Me

Technologie Sora 2 přináší úžasné výsledky. Moje agentura nyní používá tento generátor pro všechny klientské projekty.

Cena Sora 2 je rozumná

Zkontroloval jsem cenu sora 2 a okamžitě se zaregistroval. Hodnota, kterou získáte z generátoru, nemá na trhu obdoby.

Milujte funkci Sora 2 Prompts

Použití výzev sora 2 usnadňuje vytváření obsahu. Vytvářím anime klipy denně a Sora 2 přesně rozumí tomu, co chci.

Sora 2 funguje perfektně

Rozhraní Sora 2 je intuitivní. Generování obsahu z mých fotografií trvá jen pár minut. Vřele doporučuji každému tvůrci.

Žádné problémy s vodoznakem Sora AI

Prémiový plán zcela odstraní vodoznak sora AI. Moje komerční klipy vypadají čistě a profesionálně díky Sora 2.