Ogni tutorial di ComfyUI sulla conversione da immagine a video promette risultati impeccabili con 8 GB di VRAM. I commenti, però, raccontano una storia diversa: crash per esaurimento della memoria, volti deformati e tempi di rendering che mettono a dura prova la pazienza. Il panorama dei modelli 3D cambia di mese in mese, le affermazioni sull'hardware raramente si rivelano veritiere e i principianti spesso abbandonano il loro primo flusso di lavoro prima ancora di produrre un singolo video utilizzabile.

Questa guida fornisce benchmark hardware affidabili, raccomandazioni chiare sui modelli per ogni fascia di GPU, una procedura dettagliata per l'utilizzo di WAN 2.2 e soluzioni agli errori più comuni che bloccano i nuovi utenti.

Che cos'è ComfyUI Image-to-Video?

ComodoUI è un editor di flussi di lavoro visivo open-source basato su nodi che è diventato la piattaforma leader per la creazione locale di video con intelligenza artificiale, con oltre 4 milioni di utenti e 60,000 nodi disponibili.

Come funziona la generazione di video da immagini tramite intelligenza artificiale

La conversione da immagine a video (I2V) utilizza modelli di diffusione per animare una singola immagine statica in una sequenza di fotogrammi. Il modello prende l'immagine sorgente come input di condizionamento, quindi riduce progressivamente il rumore di una rappresentazione latente attraverso più fotogrammi. Il risultato è una breve clip video, in genere da 3 a 10 secondi, in cui la scena e i soggetti prendono vita con un movimento coerente.

Perché ComfyUI per la generazione di video

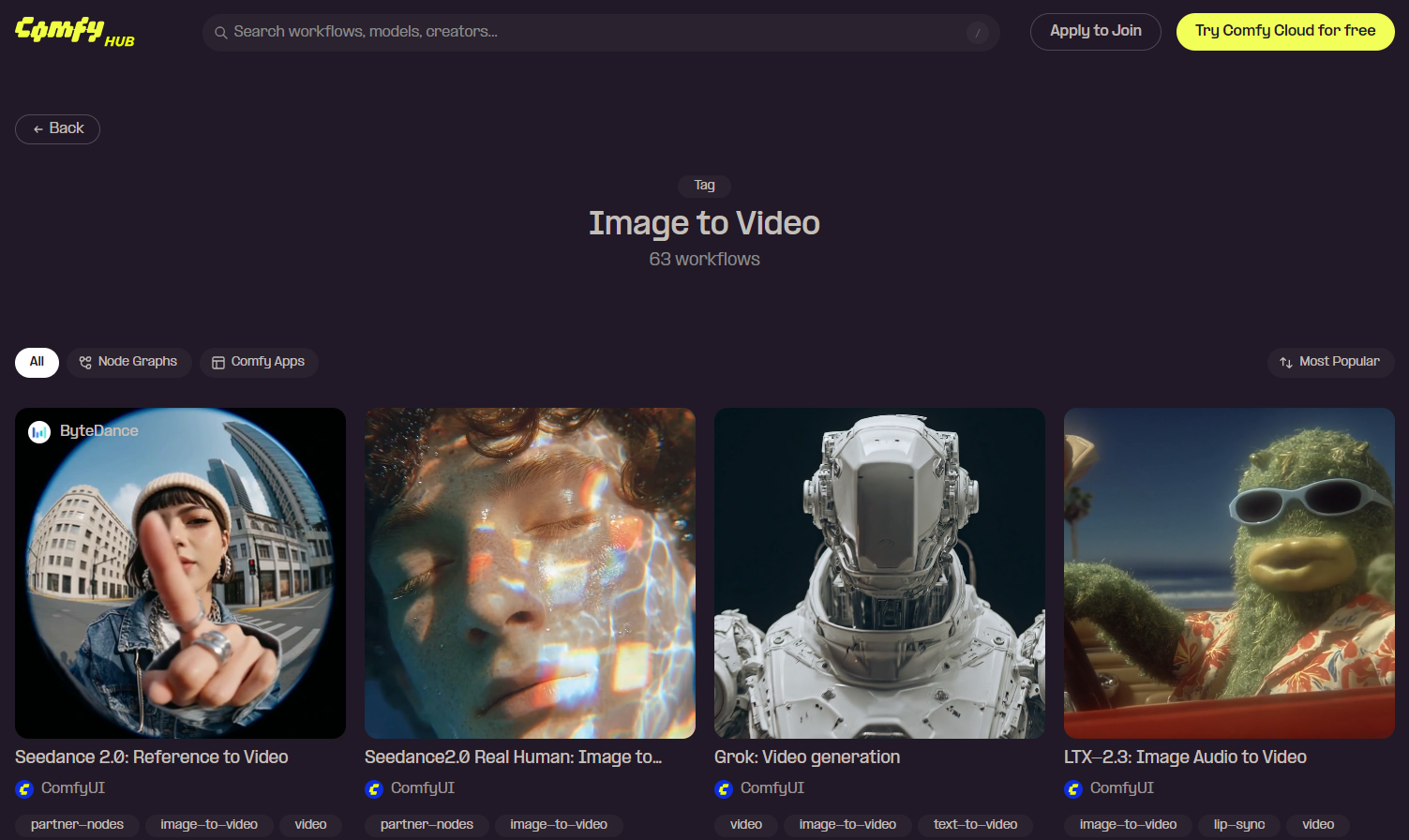

ComfyUI supporta ogni principale modello video — Wan 2.2, LTX 2.3, Seedance, LongCat e altro ancora — all'interno di un'unica interfaccia. Funziona sul tuo hardware a costo zero per generazione, mantiene i tuoi dati privati e offre una comunità fiorente che condivide flussi di lavoro scaricabili attraverso il centro ufficiale.

Generatori video locali vs. basati su cloud di ComfyUI

L'esecuzione in locale offre generazioni illimitate e gratuite e il pieno controllo creativo, ma richiede hardware GPU performante. Le piattaforme cloud eliminano la barriera hardware: si carica un'immagine, si sceglie un modello e si ottengono i risultati senza installare nulla. Strumenti come AI Image to Video offrono output di alta qualità con modelli come Kling, Veo e Wan fino a una risoluzione 4K, risultando ideali per i social media e il marketing.

I migliori modelli di conversione da immagine a video per ComfyUI nel 2026

La scelta del modello giusto è la decisione più importante per il flusso di lavoro I2V.

Wan 2.2 14B — Migliore qualità complessiva

Migliori Scelta unanime della comunitàWAN 2.2 offre un'esperienza di movimento cinematografica, una conformità precisa ai prompt e il più ampio ecosistema LoRA (Lightning, CausVid, Lightx2v). La quantizzazione GGUF rende il modello 14B accessibile alle GPU consumer. Compromesso: assenza di audio nativo. Minimo 12 GB di VRAM con Q4; 16-24 GB consigliati.

LTX 2.3 — Ideale per video con audio

L'unico modello open-source principale che genera audio sincronizzato con il videoPiù veloce di WAN con ControlNet e supporto per lo scambio di volti, oltre alla quantizzazione GGUF da 8 GB a oltre 40 GB. Qualità video e adesione rapida paragonabili a WAN 2.2.

LongCat: ideale per video di lunga durata.

Costruito su Wan 2.2, LongCat genera video di durata illimitata tramite estensione scena per scena. Compatibile con Wan LoRA, ma la coerenza dei caratteri si discosta dopo i primi fotogrammi. Richiede 16 GB o più di VRAM.

Seedance 2.0: ideale per video con persone reali.

Il modello di ByteDance utilizza verifica dell'identità per garantire la coerenza dei volti umani tra le generazioni, supportando input multi-riferimento (fino a 9 immagini, 3 video, 3 clip audio). Le preoccupazioni della comunità si concentrano sulla raccolta dei dati biometrici.

Altri modelli degni di nota (OVI, HappyHorse, Wan Animate)

- OVI 11B: Clip di 10 secondi con supporto per tag di parlato per i contenuti di dialogo

- HappyHorse 1.0Estetica cinematografica in stile Pixar, riprese multiple fino a 15 secondi

- Wan 2.2 AnimateTrasferisce il movimento da un video di riferimento a immagini fisse.

Tabella di confronto dei modelli

| Modello | Museale | Durata massima | audio | VRAM minima | Supporto LoRA |

| Wan 2.2 14B | Ottimo | ~ 5 s | Non | 12 GB (GGUF) | Estensivo |

| LTX 2.3 | Buone | ~ 5 s | Si | 12GB | Si |

| LongCat | Buone | Illimitato | Non | 16GB | Compatibile con WAN |

| Danza dei semi 2.0 | Molto Buone | ~ 5 s | Si | Cloud | Limitato |

| OVI 11B | Buone | 10 secondi | Tramite MMAudio | 16GB | Non |

Requisiti hardware e guida alla VRAM

La verità sugli 8 GB di VRAM

La maggior parte dei tutorial sugli "8GB" ha sezioni di commenti piene di errori di memoria insufficiente (OOM). È possibile ottenere un video a bassa risoluzione con una quantizzazione aggressiva, ma l'esperienza non è affidabile. Considerate 12 GB come il valore minimo realistico.

Suddivisione delle GPU per fascia di prezzo (12 GB / 16 GB / 24 GB)

- 12 GB (RTX 3060): Wan 2.2 14B Q4 GGUF a risoluzioni moderate. Circa 50 minuti per clip da 5 secondi.

- 16 GB (RTX 4060 Ti): Punto ottimale. Wan 2.2 Q5_K_M a 720p in 12-14 min. Risoluzione ottimale: 816 × 1088.

- 24 GB (RTX 4080/4090)La maggior parte dei modelli funziona senza restrizioni. Quantizzazione Q8, generazione in 5-10 minuti.

Anche la RAM di sistema è importante.

Spesso trascurati: I modelli fp8 necessitano di 64 GB di RAM di sistema. mentre le versioni GGUF funzionano con 32 GB. DisTorch consente ai modelli di eseguire lo streaming dalla RAM di sistema, rendendo 64 GB di RAM più efficaci rispetto a una maggiore VRAM in alcune configurazioni.

AMD, Apple Silicon e Intel Arc

- AMDROCm funziona su Linux con alcune limitazioni; inaffidabile su Windows. SageAttention non disponibile, bug di rallentamento del decodificatore VAE. VAE a riquadri essenziale.

- Silicon AppleIl formato Float8 non è supportato dal backend MPS, bloccando molti flussi di lavoro.

- Intel ArcoProduce un output inutilizzabile senza una soluzione alternativa evidente.

Alternative alle GPU in cloud

RunPod addebita circa $0.50-1.00/ora, Vast.ai offre RTX 5090 per meno di $0.50/ora e CorriComodo offre macchine con fino a 80 GB di VRAM e modelli preinstallati.

Passo dopo passo: la tua prima conversione da immagine a video con ComfyUI

Questa guida utilizza Wan 2.2 14B GGUF per guidarti da zero al primo video.

Passaggio 1: Installa o aggiorna ComfyUI

Scarica l'ultima versione da comfy.org. Se è già installato, aggiornare prima — Le versioni precedenti causano errori di "nodo mancante rosso" con i flussi di lavoro attuali.

Passaggio 2 — Scarica il modello Wan 2.2 14B GGUF

Seleziona la quantizzazione GGUF per la tua VRAM: Q4 da 12 GB, Q5_K_M per 16 GB, Q8 da 24 GB. Posiziona il file in ComfyUI/models/diffusion_models/Saltate completamente il modello 5B.

Passaggio 3: Carica il flusso di lavoro I2V ufficiale

Apri il flusso di lavoro ufficiale Wan 2.2 I2V. Trascina il JSON in ComfyUI. Se i nodi appaiono rossi, usa Gestore di ComfortUI per installare automaticamente le dipendenze mancanti.

Passaggio 4: configura le impostazioni e carica la tua immagine

Carica un'immagine sorgente alla risoluzione nativa WAN: 960 × 960, 784 × 1136, o 720 × 1264Per ottenere risultati ottimali, ingrandisci prima l'immagine sorgente, quindi genera l'immagine a una risoluzione inferiore per preservare i dettagli e ridurre al contempo l'utilizzo della VRAM.

Passaggio 5 — Scrivi il tuo prompt di movimento e genera

Mantieni i prompt semplici e focalizzati sull'azione: "si gira lentamente verso la telecamera", "i capelli ondeggiano dolcemente al vento". Imposta i passaggi su 20-30, usa il campionatore predefinito e fai clic Richiesta di codaPrevedibilmente 5-15 minuti su una GPU con 16 GB o superiore.

Passaggio 6: Rivedi, itera ed esporta

Verifica la presenza di artefatti di movimento o movimenti indesiderati della telecamera nell'output. Regola il seed per la variazione, perfeziona i prompt o aumenta il numero di passaggi. Valuta la possibilità di post-produzione con interpolazione dei fotogrammi o upscaling.

Tecniche avanzate e ottimizzazione

Speed LoRAs: Genera video 5-10 volte più velocemente

Tre sensori LoRA riducono drasticamente i tempi di rendering: Illuminazione (generazione in 4 fasi), CausVid_v2 (intensità 0.3-0.5) e Lightx2v (Intensità 0.4-0.6). La combinazione CausVid + Lightx2v è la preferita dalla community. Disabilita TeaCache Quando si utilizzano questi prodotti, si danneggiano mani, capelli e movimenti rapidi.

Spiegazione della quantizzazione GGUF

GGUF comprime modelli di grandi dimensioni con perdita di qualità controllata. Q8 mantiene una qualità quasi completa, Q5_K_M bilancia dimensioni e output, Q4 è il minimo per risultati accettabili. I modelli GGUF possono essere eseguiti in streaming dalla RAM di sistema, rendendo 64 GB di RAM sono più preziosi di una VRAM aggiuntiva. in alcune configurazioni.

Generazione di video lunghi oltre i 5 secondi

Usa il LongCat per l'estensione continua della scena, oppure unisci le clip inserendo il fotogramma finale di ciascuna clip come primo fotogramma della clip successiva. Tecnica FLF2V Consente cicli senza interruzioni. La coerenza dei caratteri tra le clip rimane la sfida più grande ancora irrisolta.

Aggiungere audio ai video generati dall'intelligenza artificiale

Tre percorsi: LTX 2.3 genera l'audio in modo nativo (il metodo più semplice, ma con una qualità video inferiore), MMaudio aggiunge suoni ambientali all'output Wan dopo la generazione e Wan InfiniteTalk gestisce il labiale sincronizzato e le interviste in soggettiva.

SageAttention e altre ottimizzazioni di velocità

SageAttention 3 Con triton-windows si ottengono significativi miglioramenti di velocità sulle GPU NVIDIA. VAE piastrellato Riduce il consumo massimo di memoria ed è essenziale per gli utenti AMD. L'utilizzo delle risoluzioni native del modello previene un inutile sovraccarico della VRAM. SageAttention non è disponibile su AMD.

Risoluzione dei problemi comuni relativi ai video di ComfyUI

Errori di memoria insufficiente (OOM / Out of Memory Errors)

Risoluzione inferiore, utilizzare una quantizzazione GGUF più piccola, abilitare Tiled VAE, ridurre la durata della clip. La durata del video si ridimensiona in modo esponenziale con la VRAM: raddoppiare la lunghezza più che raddoppia l'utilizzo della memoria.

Output distorto o sfocato

Il problema è quasi sempre causato dal modello Wan 5B o 1.3B. Passare al modello GGUF 14B. Verificare inoltre che le dimensioni dell'immagine corrispondano ai rapporti previsti dal modello e che sia stato caricato il VAE corretto.

Errore "Le forme mat1 e mat2 non possono essere moltiplicate"

Dimensioni non corrispondenti: le dimensioni dell'immagine non corrispondono a quelle previste dal modello. Ridimensiona l'immagine di input alla risoluzione nativa del modello e verifica di aver caricato la variante del modello corretta.

Errori rossi "Nodo mancante"

ComfyUI obsoleto o nodi personalizzati mancanti. Aggiorna alla versione più recente e utilizza Gestore di ComfortUI per installare automaticamente le dipendenze.

Movimenti indesiderati della telecamera

Inserisci "telecamera statica" o "nessun movimento della telecamera" al tuo prompt. Per un controllo più preciso, usa ControlNet o blocca le posizioni con la tecnica primo-ultimo fotogramma.

ComfyUI contro le alternative cloud: scegliere la strada giusta

Quando ComfyUI è la scelta giusta

ComfyUI è la soluzione ideale se possiedi una GPU NVIDIA con almeno 12 GB di VRAM, desideri il controllo creativo completo, hai bisogno di privacy o generi un volume di lavoro tale da rendere conveniente la formula "gratuito per ogni esecuzione".

Quando una piattaforma cloud è la scelta migliore

Se il tuo hardware non è in grado di gestire la generazione video o se desideri ottenere risultati senza dover gestire i flussi di lavoro, i servizi cloud rappresentano la scelta più pratica. Immagine AI in video Offre risultati professionali fino a 4K senza filigrane, ideale per i creatori che necessitano di tempi di consegna rapidi senza configurazioni tecniche.

Approccio ibrido: sperimentazione locale, produzione in cloud

Molti creatori realizzano prototipi in locale, testando prompt, LoRA e impostazioni, per poi passare alle GPU cloud per le produzioni finali, trovando un equilibrio tra controllo creativo e velocità di rendering.

Domande frequenti su ComfyUI Image to Video

Qual è il miglior modello di conversione da immagine a video per ComfyUI?

Wan 2.2 14B per la qualità visiva, LTX 2.3 per l'audio nativo. Non utilizzare mai la variante Wan 5B.

Di quanta VRAM hai bisogno per la generazione video di ComfyUI?

Minimo 12 GB per risultati utilizzabili. 16 GB per una risoluzione 720p confortevole. 24 GB per flussi di lavoro senza limitazioni.

È possibile eseguire la conversione da immagine a video di ComfyUI con 8 GB di VRAM?

Tecnicamente sì, ma aspettati frequenti errori di memoria insufficiente (OOM) e risoluzioni molto basse. 12 GB o più sono decisamente più affidabili.

Quanto tempo ci vuole per generare un video in ComfyUI?

Da 5 a 15 minuti su RTX 4070/4080, fino a 50 minuti su RTX 3060. Speed LoRA riduce i tempi di 5-10 volte.

WAN 2.2 vs LTX 2.3: qual è la scelta migliore?

WAN 2.2 è superiore in termini di qualità e ecosistema LoRA. LTX 2.3 vince in velocità e audio nativo. La scelta dipende dalle tue priorità.

Posso utilizzare ComfyUI per convertire immagini in video su sistemi AMD o Mac?

Le schede AMD su Linux funzionano con alcune limitazioni. Le schede AMD su Windows sono inaffidabili. I processori Apple Silicon non supportano i modelli Float8. Le piattaforme cloud sono spesso più affidabili per gli utenti che non utilizzano schede NVIDIA.

Come faccio a creare video più lunghi di 5 secondi?

Usa il LongCat per la generazione continua o per l'unione di clip utilizzando ogni fotogramma finale come immagine di partenza successiva. FLF2V consente cicli senza interruzioni.

Conclusione

Inizia con Wan 2.2 14B GGUF per la migliore qualità visiva, assicurarsi almeno 12GB VRAM (16-24 GB consigliati) e segui il flusso di lavoro sopra descritto per produrre la tua prima clip. Il panorama I2V si evolve rapidamente, quindi rivedi la tua configurazione ogni pochi mesi per rimanere aggiornato.

Pronto per iniziare? Scarica la Flusso di lavoro GGUF Wan 2.2 14B e segui il tutorial qui sopra.